Файл robots.txt – это ключевой инструмент для управления индексацией сайта в поисковых системах. В системе 1C-Битрикс его правильная настройка позволяет эффективно ограничивать доступ к техническим разделам, управлять обходом страниц и избегать дублирования контента. Неправильно настроенный файл может привести к потере позиций в поисковой выдаче или, что еще хуже, к полному исключению страниц из индексации.

В Битрикс файл robots.txt по умолчанию располагается в корневой директории сайта: /robots.txt. При отсутствии этого файла его необходимо создать вручную и разместить в корне веб-проекта. Это важно, так как поисковые боты в первую очередь обращаются именно к этому пути при сканировании сайта. Если файл отсутствует, роботы попытаются индексировать все страницы без ограничений.

Для редактирования файла можно воспользоваться файловым менеджером в административной панели Битрикс или подключиться по FTP. Изменения вступают в силу сразу после сохранения, однако обновление данных в поисковых системах может занять время, в зависимости от частоты обхода сайта ботами.

Настройка robots.txt в Битрикс позволяет гибко управлять индексацией. Например, чтобы закрыть от индексации служебные директории, достаточно добавить строки:

User-agent: * Disallow: /bitrix/ Disallow: /upload/ Disallow: /local/

Кроме того, можно указать путь к файлу sitemap.xml для упрощения обхода сайта поисковыми роботами:

Sitemap: https://example.com/sitemap.xml

Правильно настроенный robots.txt в Битрикс – это не только удобство для поисковых систем, но и гарантия того, что технические страницы не попадут в индекс, а ценный контент будет сканироваться и отображаться в поисковой выдаче максимально эффективно.

Местоположение и настройка файла robots.txt в Битрикс

Файл robots.txt в Битрикс располагается в корневой директории сайта и доступен по пути /robots.txt. Если файл отсутствует, его необходимо создать вручную и загрузить в корень сайта через FTP или файловый менеджер хостинга.

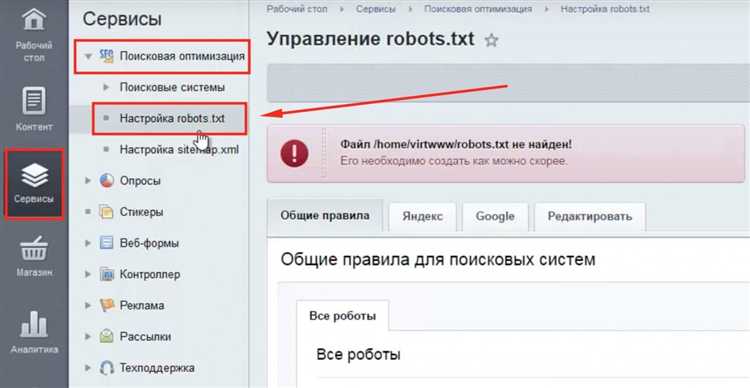

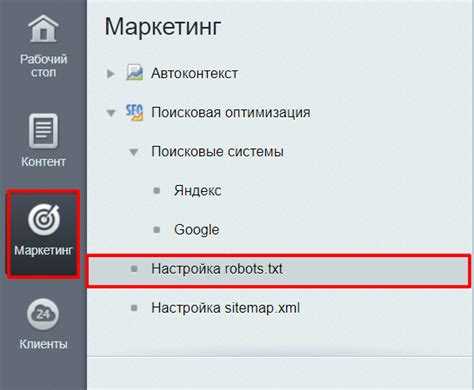

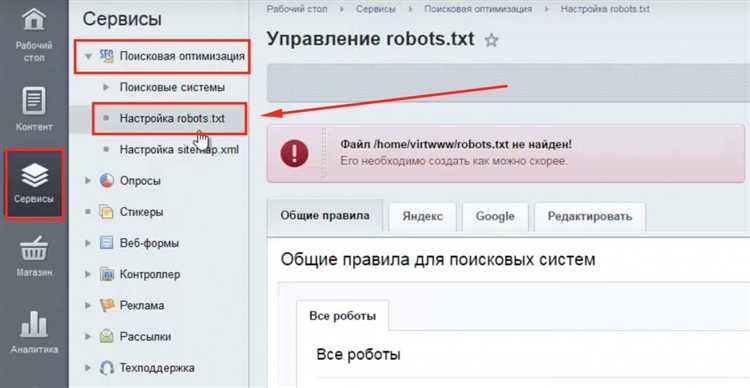

Для редактирования файла можно использовать административную панель Битрикс. Перейдите в «Настройки» → «Инструменты» → «Файл robots.txt». Здесь доступен интерфейс для удобного управления содержимым без необходимости прямого доступа к серверу.

Базовая структура robots.txt в Битрикс обычно включает указание на запрет индексации служебных директорий:

User-agent: * Disallow: /bitrix/ Disallow: /upload/ Disallow: /local/ Disallow: /personal/

Для разрешения индексации определённых страниц или разделов используется директива Allow. Например, для открытия доступа к картинкам в директории /upload/:

Allow: /upload/iblock/

Если сайт использует sitemap, его путь следует прописать в robots.txt:

Sitemap: https://example.com/sitemap.xml

Чтобы избежать ошибок, рекомендуется проверять файл через инструменты Яндекс.Вебмастер или Google Search Console. Также полезно использовать модуль «SEO» в Битрикс для анализа корректности настроек.

Правильная настройка robots.txt в Битрикс помогает улучшить индексацию ресурса и избежать дублирования страниц в поисковых системах.

Путь к файлу robots.txt в структуре Битрикс

Файл robots.txt в Битрикс располагается в корневой директории сайта. Это стандартное место, которое сканеры поисковых систем автоматически проверяют при обходе ресурса. Правильное расположение файла позволяет эффективно управлять индексацией разделов и страниц сайта.

- Путь к файлу в файловой структуре сервера:

/home/username/public_html/robots.txt, гдеusername– это имя пользователя хостинга. - Если Битрикс развернут в отдельной папке, путь будет выглядеть следующим образом:

/home/username/public_html/bitrix_folder/robots.txt. - Для мультисайтовой конфигурации файл

robots.txtсоздается для каждого домена отдельно в его корневой директории.

Чтобы изменить файл robots.txt, можно воспользоваться:

- FTP-клиентом (например, FileZilla) для прямого доступа к серверу.

- Файловым менеджером в панели управления хостингом (cPanel, ISPmanager и др.).

- Внутренним файловым менеджером Битрикс в разделе «Файлы и папки».

После редактирования файла рекомендуется проверить его доступность по адресу: https://yourdomain.com/robots.txt. В случае возникновения ошибки 404 необходимо убедиться, что файл действительно размещен в корневой директории и имеет правильные права доступа (обычно 644).

Для мгновенного обновления информации в поисковых системах рекомендуется воспользоваться инструментами для вебмастеров (Яндекс.Вебмастер, Google Search Console), чтобы отправить запрос на повторное сканирование файла robots.txt.

Создание и редактирование файла robots.txt в Битрикс

Файл robots.txt предназначен для управления индексацией сайта поисковыми системами. В Битрикс этот файл находится в корневой директории сайта и доступен по пути /robots.txt. Если файл отсутствует, его необходимо создать вручную.

Шаги по созданию файла robots.txt

- Подключитесь к серверу через FTP или используйте файловый менеджер в панели управления хостингом.

- В корневой директории сайта создайте текстовый файл с именем

robots.txt. - Заполните его базовыми инструкциями, например:

User-agent: *

Disallow: /bitrix/

Disallow: /upload/

Allow: /upload/iblock/

Sitemap: https://example.com/sitemap.xml

Редактирование файла robots.txt в Битрикс

- Чтобы внести изменения, откройте файл

robots.txtв любом текстовом редакторе или через файловый менеджер хостинга. - Добавьте или измените правила в соответствии с требованиями индексации.

- Сохраните изменения и проверьте доступность файла по ссылке

https://example.com/robots.txt.

Рекомендации по настройке robots.txt в Битрикс

- Запрещайте индексацию системных директорий:

/bitrix/,/local/,/upload/, кроме необходимых исключений. - Не закрывайте от индексации

/bitrix/templates/, если там находятся критически важные для SEO файлы CSS или JS. - Указывайте путь к файлу карты сайта с помощью директивы

Sitemap. - Регулярно проверяйте файл на ошибки с помощью инструментов Яндекс.Вебмастер и Google Search Console.

Частые ошибки при настройке robots.txt

- Пропуск директории

/local/, которая содержит модули и компоненты, также требующие закрытия от индексации. - Неуказанный путь к карте сайта, что снижает скорость индексации новых страниц.

- Избыточные или конфликтующие правила, которые могут блокировать важные страницы.

Корректная настройка robots.txt в Битрикс помогает избежать избыточной индексации служебных данных и ускоряет обнаружение поисковыми роботами важных разделов сайта.

Настройка правил для индексации разделов сайта

Файл robots.txt позволяет управлять индексацией разделов сайта в поисковых системах. В Bitrix он находится по адресу: /robots.txt в корневой директории. Грамотно настроенные правила помогают избежать попадания в выдачу дублированных страниц, закрыть технические разделы и оптимизировать обход сайта роботами.

Чтобы ограничить индексацию определенного раздела, используется директива Disallow. Например, чтобы закрыть от индексации раздел /bitrix/, добавьте в robots.txt:

Disallow: /bitrix/

Если необходимо разрешить индексацию отдельной страницы в закрытом разделе, добавляется Allow:

Disallow: /private/ Allow: /private/open-page.html

Для управления доступом разных поисковых систем можно использовать директиву User-agent. Пример настройки для Google:

User-agent: Googlebot Disallow: /admin/

Аналогично настраивается доступ для Яндекса:

User-agent: Yandex Disallow: /test-section/

Чтобы закрыть от индексации страницы с параметрами, можно применить маску:

Disallow: /*?*

Если на сайте есть динамические фильтры или пагинация, которые создают дубликаты, это правило избавит от их индексации:

Disallow: /*PAGEN_*

При настройке важно учитывать приоритеты: чем ниже директива в файле, тем она приоритетнее. Поэтому общие правила лучше размещать выше, а более детализированные – ниже. Правильно настроенный robots.txt ускоряет обход сайта и помогает избежать ошибок при индексации.

Запрет на индексацию служебных страниц в Битрикс

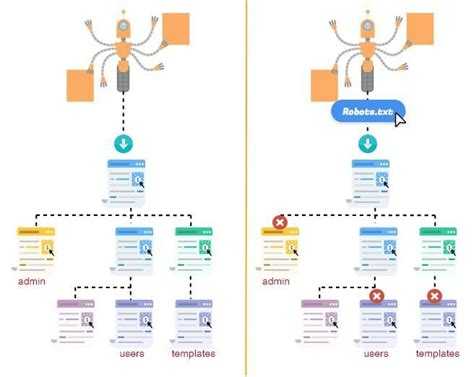

Служебные страницы в Битрикс, такие как результаты поиска, корзина, личный кабинет и страницы авторизации, не несут ценности для поисковых систем. Их индексация может привести к увеличению объема «мусорных» страниц в поисковой выдаче, снижению релевантности и перерасходу краулингового бюджета.

Для исключения этих страниц из индексации используется файл robots.txt. В нем необходимо прописать запрет на индексацию определенных разделов и параметров. Примеры основных служебных страниц в Битрикс, которые следует закрыть:

Disallow: /personal/ – запрет на индексацию личного кабинета.

Disallow: /search/ – запрет на индексацию результатов поиска.

Disallow: /cart/ – запрет на индексацию корзины.

Disallow: /auth/ – запрет на индексацию страницы авторизации.

Disallow: /bitrix/ – полное исключение служебных директорий CMS.

В некоторых случаях на сайте могут быть динамические параметры, создающие дубли страниц. Для их блокировки можно добавить правило:

Disallow: /*?* – запрет на индексацию всех URL с параметрами.

Также рекомендуется использовать мета-тег noindex, nofollow для дополнительных гарантий. Этот мета-тег прописывается в шаблонах страниц, которые не должны индексироваться, например:

<meta name="robots" content="noindex, nofollow">

После обновления robots.txt необходимо проверить доступность страниц через инструмент Google Robots Testing Tool и убедиться в правильности настроек. Это исключит вероятность ошибок и повысит качество индексации сайта.

Оптимизация robots.txt для многоязычных сайтов на Битрикс

Для многоязычных сайтов на Битрикс важно корректно настроить файл robots.txt с учётом особенностей структуры URL и параметров языка. В системе Битрикс URL языковых версий обычно имеют префиксы: /en/, /de/ и т.д., либо используются GET-параметры (?lang=en).

Рекомендуется явно разрешить индексирование всех языковых разделов, прописав для каждого User-agent соответствующие директивы Allow. Например:

Allow: /en/ – для английской версии, Allow: /fr/ – для французской и так далее. Если используются параметры, стоит разрешить индексацию URL с языковыми параметрами, исключая при этом дублирующий контент.

Чтобы избежать проблем с дублированием, следует закрыть от индексации страницы без языкового префикса, если основной сайт не должен быть индексирован отдельно, например:

Disallow: /index.php или Disallow: /?lang= при неправильной параметризации. Это предотвращает попадание в индекс пустых или неуникальных страниц.

Важный момент – избегать глобального запрета индексации через Disallow: /, который блокирует все языковые разделы. Вместо этого структурируйте правила по языковым папкам и параметрам.

Для динамических URL с параметрами рекомендуется дополнительно настроить директивы Noindex или использовать канонические ссылки внутри сайта, чтобы избежать конфликтов. В файле robots.txt можно запретить индексацию отдельных параметров с помощью правила:

Disallow: /*?*param=, где param – имя нежелательного GET-параметра.

При интеграции с Битрикс лучше обновлять файл robots.txt через административную панель – раздел «Настройки» → «Инструменты» → «Файл robots.txt». Это позволяет корректно учитывать структуру сайта и автоматизировать добавление новых языков.

Итог: файл robots.txt для многоязычных сайтов на Битрикс должен учитывать все языковые префиксы, исключать дубли и ограничивать индексацию нежелательных параметров, обеспечивая точное управление доступом поисковых роботов к контенту на каждом языке.

Проверка правильности настроек robots.txt в Битрикс

Для проверки корректности файла robots.txt в Битрикс сначала убедитесь, что файл расположен в корневой директории сайта: /robots.txt. Это единственное корректное местоположение, позволяющее поисковым системам его обнаружить.

Далее проверьте содержимое файла через стандартный инструментарий Яндекса и Google. Для Яндекса используйте раздел «Вебмастер» → «Анализ файла robots.txt». Загрузите текущий файл и протестируйте отдельные URL, чтобы убедиться, что нужные страницы разрешены или запрещены к индексации согласно ожиданиям.

Для Google применяйте «Инструмент проверки файла robots.txt» в Google Search Console. Здесь также тестируется доступ к страницам, что позволяет выявить ошибки в синтаксисе или логике правил.

Обязательно проверьте, что в файле отсутствуют дублирующие правила и синтаксические ошибки, такие как неправильное использование директив Disallow и Allow. Например, для блокировки папки необходимо использовать слэш в конце: Disallow: /bitrix/admin/.

В Битрикс рекомендуется дополнительно проверить, не генерирует ли система динамический robots.txt, который может перекрывать статический файл. Это можно проверить, открыв URL сайта с добавлением параметра ?robots=content. Если содержимое отличается от файла robots.txt, настройте приоритет статического файла через настройки модуля «SEO».

После внесения изменений в robots.txt обязательно очистите кэш сайта, чтобы новые правила вступили в силу.

Периодически повторяйте проверку после обновлений CMS или изменений структуры сайта, чтобы убедиться, что поисковые роботы получают актуальные и корректные инструкции.

Обновление robots.txt при изменении структуры сайта

При изменении структуры сайта в Битрикс необходимо обязательно корректировать файл robots.txt. Этот файл управляет индексацией страниц поисковыми системами, поэтому любые изменения в URL, добавление новых разделов или удаление старых требуют обновления правил.

Первый шаг – определить новые пути, которые нужно закрыть от индексации или, наоборот, открыть. В Битриксе структура URL часто меняется при редактировании инфоблоков, компонентов и ЧПУ. Проверьте, что все новые разделы корректно описаны в файле.

Используйте директиву Disallow для блокировки доступа к внутренним административным страницам, дублирующемуся контенту и временным разделам. Если появились новые каталоги, которые не должны индексироваться (например, /bitrix/, /local/), добавьте их явно.

Для предотвращения ошибок важно проверить файл robots.txt на синтаксис и доступность после правок. В Битриксе редактирование можно выполнить через административную панель в разделе «Настройки» → «Настройки продукта» → «Поисковые роботы». После сохранения сразу протестируйте файл через Google Search Console или Яндекс.Вебмастер.

При использовании динамических URL и параметров необходимо контролировать правила с помощью директив Allow и Disallow с учетом параметров запроса, чтобы избежать индексации одинакового контента по разным ссылкам.

Регулярно пересматривайте robots.txt после крупных обновлений или запуска новых модулей в Битриксе, чтобы файл всегда отражал актуальную структуру сайта и обеспечивал оптимальную индексацию.

Решение частых ошибок при настройке robots.txt в Битрикс

Ошибка 1. Некорректное расположение файла. В Битрикс robots.txt должен находиться в корневой директории сайта, где расположен index.php. Если файл помещен в подкаталог, поисковые роботы его не обнаружат. Проверьте путь через FTP или файловый менеджер хостинга.

Ошибка 2. Неправильный формат и кодировка. robots.txt должен быть в кодировке UTF-8 без BOM. Использование других кодировок приводит к ошибкам чтения. Файл должен содержать только ASCII-символы, лишние пробелы и не поддерживаемые символы недопустимы.

Ошибка 3. Отсутствие обязательных директив для Битрикс. Важно блокировать системные папки, например, /bitrix/, чтобы избежать индексации служебных страниц. Пример правильной строки: Disallow: /bitrix/. Также необходимо разрешить доступ к основным страницам сайта и публичным ресурсам.

Ошибка 4. Перезапись файла через админку Битрикс. При ручном изменении файла через FTP изменения могут быть перезаписаны системой, если включена опция автоматического обновления robots.txt в настройках SEO-модуля. Для сохранения правок отключите автоматическую генерацию или используйте встроенный редактор.

Ошибка 5. Отсутствие проверки после изменений. После редактирования robots.txt обязательно проверьте файл через Google Search Console или другие инструменты анализа. Это позволит выявить синтаксические ошибки, некорректные правила и конфликтующие директивы.

Ошибка 6. Блокировка важных страниц. Часто из-за чрезмерного использования Disallow: / или масок с wildcard запрещается индексация нужных разделов. Рекомендуется тщательно анализировать правила и тестировать каждый блок, чтобы не закрыть ключевые страницы от роботов.

Ошибка 7. Необновление robots.txt после изменения структуры сайта. При добавлении новых модулей, смене URL или установке компонентов в Битрикс необходимо своевременно корректировать файл. Иначе поисковые системы будут работать с устаревшей картой запретов и разрешений.

Решение всех перечисленных проблем требует системного подхода: правильное размещение, точное написание директив, использование инструментов контроля и регулярное обновление файла. Это обеспечит корректную индексацию и улучшит SEO-показатели сайта на Битрикс.

Вопрос-ответ:

Где именно располагается файл robots.txt в проекте на Битрикс?

Файл robots.txt должен находиться в корневой директории сайта, то есть в той же папке, где расположен файл index.php. Это важно, потому что поисковые роботы автоматически ищут этот файл именно в корне сайта для определения правил индексации.

Каким образом можно изменить содержимое файла robots.txt через административную панель Битрикс?

В административной панели Битрикс есть специальный раздел для работы с файлом robots.txt. Для этого нужно перейти в настройки сайта, затем найти пункт «Файл robots.txt». Там можно редактировать текст файла, добавлять или удалять правила для поисковых систем, после чего сохранить изменения. Это удобный способ избежать прямого редактирования через FTP или файловый менеджер.

Что произойдет, если файл robots.txt отсутствует в корне сайта на Битрикс?

Если файл robots.txt отсутствует, поисковые системы будут считать, что нет никаких ограничений на индексацию страниц сайта. Это может привести к индексации всех доступных разделов, включая те, которые не желательно показывать в поисковой выдаче, например, административные или тестовые страницы.

Можно ли разместить файл robots.txt в подкаталоге сайта на Битрикс и будет ли он работать?

Файл robots.txt работает только в корне сайта и не распознается, если находится в подкаталоге. Например, если вы поместите его в папку /catalog/, поисковые роботы его проигнорируют. Чтобы правила были применены, файл должен лежать непосредственно в корневой папке сайта.

Как правильно настроить файл robots.txt, чтобы заблокировать индексацию административного раздела в Битрикс?

Для ограничения доступа поисковиков к административной части сайта в файле robots.txt нужно прописать директиву Disallow, указывающую путь к административной папке, например:

User-agent: *

Disallow: /bitrix/admin/

Это означает, что всем поисковым роботам запрещено сканировать раздел /bitrix/admin/. Такая настройка помогает защитить внутренние страницы от попадания в поисковую выдачу.