Создание нейросети с нуля на Python – это процесс, который начинается с выбора подходящих библиотек и алгоритмов, а затем включает в себя реализацию самого алгоритма с учётом специфики задачи. Python является одним из самых популярных языков для машинного обучения благодаря своей простоте, мощным библиотекам и активному сообществу. В этой статье мы шаг за шагом пройдем путь от идеи до работающей нейросети, начиная с основы и заканчивая созданием первой модели.

Первым шагом является знакомство с основными компонентами нейросетей. Вам нужно понимать, что нейросеть состоит из слоев, где каждый слой обрабатывает данные через нейроны, используя веса и функции активации. Основная цель – оптимизация весов для минимизации ошибки модели. Важно начать с базовых понятий, таких как обратное распространение ошибки и градиентный спуск, чтобы правильно настроить обучение модели.

Библиотеки и инструменты для создания нейросети на Python включают такие пакеты, как TensorFlow, Keras, PyTorch и другие. Но для начала, чтобы понять, как всё устроено на более низком уровне, стоит использовать NumPy для вычислений и реализации базовых операций, таких как умножение матриц и работа с массивами. Эти операции являются основой для создания нейросетевых слоев и их обучения.

Для начала работы вам понадобятся данные, которые будут использоваться для тренировки модели. Важно выбрать правильный набор данных, который соответствует вашей задаче, будь то классификация изображений или прогнозирование временных рядов. После этого нужно подготовить данные, например, нормализовать их и разделить на тренировочную и тестовую выборки.

Как только данные готовы, можно переходить к написанию кода нейросети, начиная с создания простого полносвязного слоя, его активации и построения функции потерь. Постепенно, шаг за шагом, вы сможете добавить новые слои, такие как сверточные или рекуррентные, и использовать более сложные методы оптимизации для улучшения результатов обучения.

Установка необходимых библиотек для создания нейросети

Для разработки нейросети на Python необходимо установить несколько ключевых библиотек. Вот шаги для их правильной установки.

1. NumPy – основная библиотека для работы с многомерными массивами и матрицами, которая предоставляет математические функции для операций над ними. Для установки выполните команду:

pip install numpy

2. Pandas используется для обработки данных, работы с табличными структурами, их манипуляции и анализа. Это важный инструмент для подготовки данных перед обучением модели. Установите её с помощью:

pip install pandas

3. Matplotlib – библиотека для визуализации данных. В ней удобно строить графики и диаграммы, что необходимо для анализа процесса обучения нейросети. Для установки выполните:

pip install matplotlib

4. TensorFlow или PyTorch – два самых популярных фреймворка для создания и обучения нейросетей. Выбор между ними зависит от предпочтений, но оба фреймворка широко используются. Для установки TensorFlow используйте:

pip install tensorflow

Если выбираете PyTorch, установите его так:

pip install torch torchvision

5. Scikit-learn – библиотека для машинного обучения, которая предоставляет инструменты для предобработки данных, создания и оценки моделей. Она особенно полезна для обучения моделей с подкреплением и для работы с алгоритмами классификации и регрессии. Установите её с помощью:

pip install scikit-learn

6. Keras – высокоуровневая библиотека для создания нейросетей, которая работает поверх TensorFlow. Keras упрощает процесс построения и обучения нейросетей, предлагая удобные API. Она уже встроена в TensorFlow, но если нужно установить отдельно, используйте:

pip install keras

7. OpenCV – библиотека для обработки изображений и видео. В контексте нейросетей она часто используется для работы с изображениями, если задача связана с компьютерным зрением. Установите её с помощью:

pip install opencv-python

8. Jupyter Notebook – инструмент для интерактивной разработки и тестирования кода. Это полезная среда, где можно создавать и запускать код по шагам. Установите Jupyter с помощью:

pip install notebook

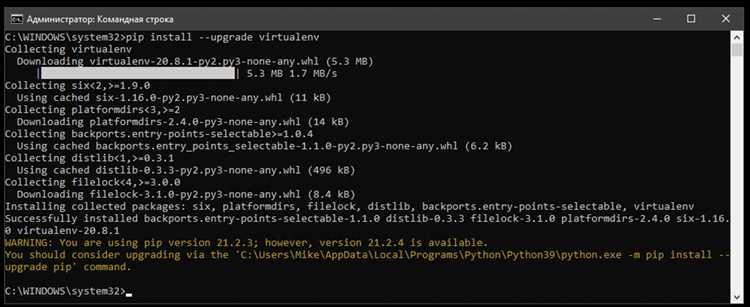

Совет: Для работы с проектами и библиотеками рекомендуется создать виртуальную среду Python. Это помогает избежать конфликтов между зависимостями разных проектов. Для создания виртуальной среды используйте:

python -m venv myenv

Активируйте её:

source myenv/bin/activate # для Linux/Mac

myenv\Scripts\activate # для Windows

После активации среды установите все необходимые библиотеки. Это гарантирует, что зависимости не будут конфликтовать с другими проектами.

Подготовка данных для обучения модели

Подготовка данных – ключевая часть процесса создания нейросети. От правильной подготовки данных зависит, насколько эффективно модель будет учить паттерны и делать прогнозы. На этом этапе важно уделить внимание нескольким аспектам.

1. Сбор и очистка данных. Начните с получения релевантных данных для задачи. Например, для классификации изображений – это могут быть наборы изображений с пометками классов. Для текстовой классификации – текстовые данные с метками. На этом этапе данные часто содержат ошибки, пропуски и аномалии, которые нужно удалить или исправить. Используйте методы фильтрации или заменяйте пропуски средними значениями для числовых данных, или наиболее частыми словами для текстов.

2. Преобразование данных. Чистые данные ещё не готовы к обучению модели. Для этого они должны быть преобразованы в формат, который легко усвоит нейросеть. Для числовых данных применяются такие методы, как нормализация или стандартизация. Например, если данные имеют разные масштабы (например, от 0 до 1 или от 0 до 10000), это может повлиять на скорость и качество обучения. Стандартизация помогает привести данные к нормальному распределению с нулевым средним и единичной дисперсией.

3. Кодирование категориальных данных. Для данных, содержащих категориальные признаки (например, цвет, пол, город), их нужно преобразовать в числовой формат. Один из популярных методов – one-hot encoding, когда каждому значению создаётся отдельная колонка с бинарными значениями. Однако, если категорий слишком много, это может привести к высокой размерности. В таком случае может быть полезно использовать технику, такую как label encoding или embedding.

4. Разделение данных на обучающую и тестовую выборки. После подготовки данных, их необходимо разделить на две части: обучающую и тестовую. Стандартное разделение – 80% на обучение и 20% на тестирование. Это позволяет проверять, насколько хорошо модель обобщает свои знания на новых, невиданных данных. Для задач, требующих валидации модели в процессе обучения, стоит выделить отдельный валидационный набор данных, обычно 10-20% от общей выборки.

5. Аугментация данных (для изображений и других типов данных). Для повышения обобщающей способности модели, особенно когда данных недостаточно, полезно использовать аугментацию. Это искусственное расширение тренировочного набора путём применения различных преобразований (например, повороты, масштабирование, изменения яркости) к изображениям. Для текстов можно использовать синонимизацию или перестановку слов. Аугментация помогает модели учить больше вариаций и уменьшать переобучение.

6. Проверка качества данных. Важно регулярно проверять качество подготовленных данных. Для этого можно визуализировать распределения признаков, проверять наличие выбросов или несоответствий. Также стоит убедиться, что данные сбалансированы – для классификационных задач важно, чтобы классы были представлены равномерно, иначе модель будет склоняться к более часто встречающимся классам.

Подготовка данных требует тщательного подхода и времени, но именно этот шаг определяет успех всего проекта. Чем качественнее подготовка, тем быстрее и точнее будет работать нейросеть. Следуя вышеизложенным рекомендациям, вы сможете создать надежный и эффективный набор данных для обучения своей модели.

Создание структуры нейросети с использованием TensorFlow или PyTorch

TensorFlow предлагает удобный API через Keras для создания и настройки нейросетевых моделей. Основным элементом структуры является Sequential модель или модель, основанная на функциональном API. Для создания нейросети нужно выбрать тип слоя, его параметры и функции активации.

Пример создания простой нейросети на TensorFlow:

import tensorflow as tf from tensorflow.keras.models import Sequential from tensorflow.keras.layers import Dense, Dropout model = Sequential([ Dense(64, activation='relu', input_shape=(784,)), Dropout(0.2), Dense(32, activation='relu'), Dense(10, activation='softmax') ]) model.compile(optimizer='adam', loss='categorical_crossentropy', metrics=['accuracy'])

В данном примере создаётся полносвязная нейросеть с тремя слоями. Важно учитывать, что первый слой требует указания input_shape, чтобы определить размер входных данных. Каждый слой может быть настроен с различными функциями активации, такими как relu, sigmoid или softmax, в зависимости от задачи.

После того как структура нейросети определена, необходимо выбрать оптимизатор и функцию потерь. В примере используется оптимизатор adam, который зарекомендовал себя как эффективный для большинства задач, и функция потерь categorical_crossentropy, подходящая для многоклассовой классификации.

PyTorch также предоставляет гибкие инструменты для построения моделей, но его подход отличается от TensorFlow. В PyTorch модель строится как класс, наследующий от nn.Module, что даёт больше контроля над процессом. Каждый слой сети создается внутри метода __init__, а вычисления происходят в методе forward.

Пример создания нейросети на PyTorch:

import torch import torch.nn as nn import torch.optim as optim class SimpleNN(nn.Module): def __init__(self): super(SimpleNN, self).__init__() self.fc1 = nn.Linear(784, 64) self.fc2 = nn.Linear(64, 32) self.fc3 = nn.Linear(32, 10) self.dropout = nn.Dropout(0.2) def forward(self, x): x = torch.relu(self.fc1(x)) x = self.dropout(x) x = torch.relu(self.fc2(x)) x = self.fc3(x) return torch.softmax(x, dim=1) model = SimpleNN() criterion = nn.CrossEntropyLoss() optimizer = optim.Adam(model.parameters(), lr=0.001)

В данном примере создаётся аналогичная модель с тремя полносвязными слоями и функцией активации relu. В PyTorch структура модели описана в классе, что позволяет легко модифицировать логику нейросети и добавлять дополнительные слои или операции. В методе forward описан порядок прохождения данных через слои, включая применение функции активации и dropout.

Важно помнить, что в PyTorch необходимо вручную управлять вычислениями и процессом обратного распространения ошибки, что даёт больше гибкости, но требует больше внимания к деталям, чем в TensorFlow.

В обоих фреймворках можно легко адаптировать структуру модели под нужды конкретной задачи, добавляя слои, изменяя функции активации или оптимизаторы. Выбор между TensorFlow и PyTorch зависит от предпочтений разработчика, сложности задачи и требуемой гибкости модели.

Обучение модели на выбранных данных

Основные этапы подготовки данных включают:

- Удаление пропущенных значений или их замену на среднее/медиану/модальное значение;

- Нормализация данных, если признаки имеют различные шкалы;

- Преобразование категориальных признаков в числовые с помощью one-hot encoding или label encoding.

Когда данные готовы, нужно выбрать модель и алгоритм обучения. Если задача классификации, можно использовать логистическую регрессию или деревья решений. Для регрессионных задач хорошо подойдут линейная регрессия или нейронные сети. Для задачи классификации, например, на наборе данных Iris, можно выбрать алгоритм k-ближайших соседей (KNN) или случайный лес.

После выбора модели необходимо настроить гиперпараметры. Для этого можно использовать метод grid search или случайный поиск для поиска наилучших параметров модели. Например, для случайного леса важно настроить количество деревьев и глубину деревьев, что значительно повлияет на результаты.

Процесс обучения модели в Python можно осуществить с использованием популярных библиотек, таких как Scikit-learn для простых моделей или TensorFlow/PyTorch для более сложных нейронных сетей. Пример с использованием Scikit-learn:

from sklearn.model_selection import train_test_split

from sklearn.ensemble import RandomForestClassifier

from sklearn.metrics import accuracy_score

# Разделение данных на обучающую и тестовую выборки

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# Обучение модели

model = RandomForestClassifier(n_estimators=100, max_depth=10)

model.fit(X_train, y_train)

# Оценка модели

y_pred = model.predict(X_test)

accuracy = accuracy_score(y_test, y_pred)

print("Accuracy:", accuracy)

В ходе обучения важно отслеживать метрики качества модели, такие как точность (accuracy), F1-меру или AUC-ROC, в зависимости от типа задачи. Для задач регрессии часто используется среднеквадратичная ошибка (MSE) или коэффициент детерминации (R²).

Кроме того, важно помнить, что модель может переобучиться на данных, если их недостаточно для тренировки или они сильно шумные. Для предотвращения переобучения можно использовать регуляризацию, увеличить количество данных или применить методы кросс-валидации для более точной оценки качества модели.

Настройка гиперпараметров для улучшения обучения

Правильная настройка гиперпараметров – ключевой фактор для успешного обучения нейросети. Гиперпараметры управляют процессом обучения и могут существенно повлиять на точность модели. Рассмотрим наиболее важные из них и рекомендации по их настройке.

- Темп обучения (Learning Rate) – один из самых важных гиперпараметров. Он определяет, насколько сильно будет изменяться вес модели на каждом шаге. Слишком большой темп может привести к «прыганию» решения, а слишком маленький – к долгому обучению или застреванию в локальных минимумах. Обычно начинают с значения 0.001 и настраивают через экспериментирование.

- Количество эпох (Epochs) – количество полных проходов по тренировочным данным. При большем количестве эпох модель может лучше подстроиться под данные, но также возрастает риск переобучения. Оптимальное значение зависит от сложности задачи, но чаще всего в задачах машинного обучения используют от 10 до 100 эпох.

- Размер батча (Batch Size) – количество примеров, которые обрабатываются на каждом шаге. Меньшие батчи обеспечивают более точное обновление весов, но увеличивают время обучения. Большие батчи ускоряют процесс, но могут приводить к меньшей точности. Хорошая практика – использовать значения от 16 до 128, в зависимости от объема данных и возможностей аппаратного обеспечения.

- Оптимизатор – алгоритм, который управляет процессом обновления весов модели. Наиболее популярные оптимизаторы:

- SGD (Stochastic Gradient Descent) – классический метод, но часто медленный и требует тщательной настройки темпа обучения.

- Adam – более эффективный оптимизатор для большинства задач, автоматически адаптирует темп обучения для каждого параметра, что ускоряет обучение.

- RMSProp – похож на Adam, но лучше работает в задачах с сильно изменяющимися градиентами.

- Регуляризация – метод уменьшения переобучения. Наиболее распространенные способы:

- L2-регуляризация – добавление штрафа к квадрату весов для уменьшения их значения и предотвращения переобучения.

- Dropout – случайное исключение нейронов в процессе обучения, чтобы предотвратить чрезмерную зависимость модели от определённых признаков.

- Инициализация весов – начальные значения весов играют важную роль в процессе обучения. Хорошей практикой является использование инициализации по методу He или Xavier, в зависимости от активационной функции. Например, для ReLU активации рекомендуется инициализация He.

- Функция активации – выбор активационной функции влияет на скорость и эффективность обучения:

- ReLU – наиболее популярная функция для скрытых слоев, но может страдать от проблемы исчезающих градиентов.

- Leaky ReLU – решение проблемы с исчезающими градиентами, позволяет не обнулять значения при отрицательных входах.

- Sigmoid и tanh – лучше использовать на выходных слоях, особенно в задачах бинарной классификации.

- Минимизация ошибки – выбор функции потерь зависит от задачи. Для регрессии используют среднеквадратичную ошибку (MSE), для классификации – кросс-энтропию. Важно учитывать тип задачи при выборе функции потерь.

Каждый гиперпараметр требует точной настройки, поэтому полезно использовать методы поиска оптимальных значений, такие как поиск по сетке или поиск случайных параметров. Также можно использовать кросс-валидацию для выбора наилучших значений гиперпараметров, минимизируя переобучение.

Оценка точности модели и устранение ошибок

После того как нейросеть обучена, важно оценить её производительность на тестовых данных. Это необходимо для того, чтобы понять, насколько модель обобщает информацию и правильно ли она решает задачу.

1. Метрики точности – первый шаг в оценке модели. Для классификационных задач часто используются метрики, такие как точность (accuracy), precision (точность), recall (полнота) и F1-меры. Например, если ваша модель классифицирует изображения на два класса, точность будет равна количеству правильно классифицированных изображений, делённому на общее количество изображений. Однако в случае несбалансированных классов точность может быть неэффективной. В таких случаях важнее смотреть на F1-меру, которая учитывает как precision, так и recall.

2. Ошибки модели можно анализировать с помощью матрицы ошибок. Она позволяет увидеть, сколько примеров было классифицировано верно, а сколько – ошибочно. Важно разделить ошибки на два типа: ложные срабатывания (false positives) и ложные отказы (false negatives). Это поможет понять, в каких случаях модель ошибается, и какие изменения могут улучшить её работу.

3. Устранение ошибок начинается с анализа данных. Если модель не показывает хороших результатов, первое, что стоит проверить – это качество данных. Обратите внимание на шум, пропущенные значения или неправильную разметку. Также проверьте, не слишком ли сложная задача для вашей нейросети. Возможно, для повышения точности потребуется больше данных для обучения или улучшение их предобработки.

4. Тюнинг гиперпараметров – ключевая стадия в устранении ошибок. Нейросети чувствительны к выбору параметров, таких как количество слоёв, размер батча, скорость обучения. Использование методов, таких как поиск по сетке или случайный поиск, позволяет найти наиболее подходящие значения гиперпараметров для конкретной задачи. Экспериментируйте с различными значениями и следите за результатами.

5. Регуляризация помогает избежать переобучения модели, что особенно актуально, если нейросеть слишком хорошо обучилась на тренировочных данных, но плохо работает на тестовых. Использование таких методов, как Dropout или L2-регуляризация, помогает сделать модель более устойчивой.

6. Улучшение архитектуры иногда является необходимым шагом. Возможно, ваша модель слишком простая для поставленной задачи. В этом случае стоит рассмотреть возможность добавления дополнительных слоёв или использование более сложных архитектур, таких как сверточные нейросети (CNN) или рекуррентные нейросети (RNN).

7. Кросс-валидация – важная техника для оценки производительности модели. Она позволяет оценить, насколько стабильно модель будет работать на разных подмножествах данных. Например, использование k-fold кросс-валидации помогает избежать случайных ошибок при разбиении данных на тренировочные и тестовые выборки.

8. Анализ ошибки на примерах помогает глубже понять поведение модели. Проанализируйте, какие конкретно примеры модель ошибочно классифицирует, и подумайте, что можно изменить в данных или архитектуре для улучшения точности.

Точный и тщательный анализ ошибки модели, выбор подходящих метрик и методов устранения проблем помогут значительно улучшить её производительность и обеспечить более высокую точность на тестовых данных.

Вопрос-ответ:

С чего начать создание нейросети на Python, если у меня нет опыта в программировании?

Если у вас нет опыта в программировании, то стоит начать с изучения основ Python и библиотек, которые применяются для создания нейросетей. Рекомендуется начать с Python, потому что это удобный и понятный язык, с множеством образовательных материалов. После этого можно изучить библиотеки, такие как NumPy, pandas и Matplotlib для обработки данных и визуализации, а затем переходить к более специфическим библиотекам, например, TensorFlow или PyTorch для создания нейросетей. Важно понимать, что создание нейросетей — это не только написание кода, но и работа с данными, поэтому стоит учить методы обработки данных и алгоритмы машинного обучения.

Какие библиотеки Python мне нужно изучить для разработки нейросети с нуля?

Для создания нейросети с нуля вам понадобятся несколько ключевых библиотек Python. Начать стоит с NumPy, которая поможет вам работать с многомерными массивами и матрицами, что важно для выполнения вычислений в нейросетях. Также стоит изучить pandas для работы с данными и их предварительной обработки, а также Matplotlib для визуализации данных. Когда вы будете готовы к созданию самой нейросети, нужно изучить TensorFlow или PyTorch — эти библиотеки позволяют строить и обучать нейросети. Важно помнить, что каждая библиотека имеет свои особенности, но для начала достаточно изучить основные возможности и принципы работы с ними.

Как выбрать подходящий тип нейросети для моей задачи?

Выбор типа нейросети зависит от типа данных и задачи, которую вы решаете. Например, для работы с изображениями часто используют свёрточные нейросети (CNN), так как они хорошо справляются с анализом визуальных данных. Для работы с текстами и языковыми моделями часто применяют рекуррентные нейросети (RNN) или трансформеры. Если задача связана с прогнозированием временных рядов, можно использовать рекуррентные нейросети, такие как LSTM или GRU. Выбор модели также зависит от сложности задачи и объема данных — для простых задач можно начать с небольших сетей, а для сложных задач потребуется более глубокая и сложная архитектура.

Какие шаги необходимо предпринять для обучения нейросети на собственных данных?

Чтобы обучить нейросеть на своих данных, нужно пройти несколько этапов. Во-первых, подготовьте и очистите данные: они должны быть в удобном формате для обработки. Для этого используйте библиотеки, такие как pandas и NumPy. Далее, разделите данные на тренировочную и тестовую выборки, чтобы проверять результаты обучения. После этого определите архитектуру нейросети (например, количество слоев и нейронов), используя библиотеки TensorFlow или PyTorch. Затем приступайте к обучению, выбирая подходящий алгоритм оптимизации, например, Adam. Важно следить за процессом обучения, проверяя, как нейросеть обучается и не переобучается, с помощью метрик, таких как точность или ошибка. Когда нейросеть обучена, можно протестировать её на тестовых данных и проверить её работу в реальных условиях.