Библиотека pandas в Python – это мощный инструмент для обработки и анализа данных, разработанный для работы с табличными данными. Она представляет собой открытый исходный код, который позволяет легко манипулировать данными, проводить их очистку и преобразования, а также выполнять различные статистические операции. Pandas используется как в исследовательской деятельности, так и в реальных проектах для работы с большими объемами данных.

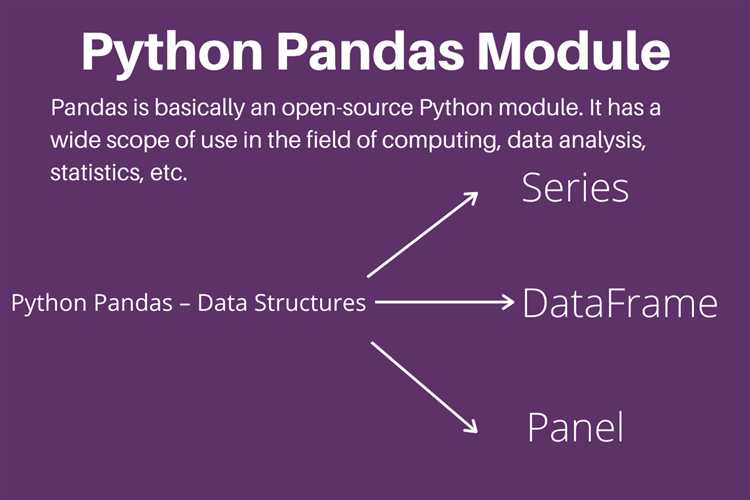

Основные структуры данных pandas – это DataFrame и Series. DataFrame представляет собой двумерную таблицу с индексами и столбцами, аналогичную таблице в базе данных или в электронных таблицах. Series – одномерный массив, аналогичный списку Python, но с дополнительными возможностями для работы с метками. DataFrame является основной структурой для работы с данными в pandas, что позволяет легко читать, фильтровать и анализировать данные в различных форматах, включая CSV, Excel, SQL и другие.

Для начала работы с pandas нужно установить библиотеку с помощью команды pip install pandas. После этого можно импортировать pandas и начать работать с данными. Основной операцией в pandas является создание объектов DataFrame из различных источников, таких как списки, словари, CSV-файлы или базы данных. Например, для чтения CSV-файла достаточно использовать команду pd.read_csv(‘file.csv’), чтобы загрузить данные в DataFrame и сразу начать с ними работать.

Для эффективного использования pandas важно овладеть базовыми операциями: фильтрацией данных с помощью условий, группировкой и агрегацией данных, а также обработкой пропущенных значений. Использование методов, таких как dropna() для удаления пропущенных данных или fillna() для их замены, позволяет значительно повысить качество данных перед их анализом. Кроме того, pandas предлагает удобные функции для работы с временными рядами, что делает его идеальным инструментом для анализа данных с временными метками.

Как установить библиотеку pandas на Python

Для работы с библиотекой pandas на Python необходимо установить её в вашу среду. Ниже приведены шаги для установки через различные инструменты.

1. Установка через pip

Самый популярный способ установки pandas – использование пакетного менеджера pip. Для этого откройте терминал или командную строку и выполните команду:

pip install pandas

Если pip не установлен, сначала установите его, следуя инструкциям на официальном сайте Python. Если у вас несколько версий Python, используйте команду python3 -m pip install pandas.

2. Установка через conda

Если вы используете Anaconda или Miniconda, вы можете установить pandas с помощью менеджера пакетов conda. Для этого выполните команду:

conda install pandas

conda автоматически подберет совместимые версии пакетов, что может быть полезно для решения зависимостей.

3. Установка в виртуальное окружение

Для изоляции проекта и предотвращения конфликтов между зависимостями рекомендуется использовать виртуальные окружения. Для создания и активации виртуального окружения выполните следующие шаги:

- Создайте виртуальное окружение:

- Активируйте его:

- Установите pandas в виртуальное окружение:

python -m venv myenv

source myenv/bin/activate (для Linux/Mac)

myenv\Scripts\activate (для Windows)

pip install pandas

4. Проверка установки

После завершения установки рекомендуется проверить, что pandas успешно установлен. Для этого откройте Python-оболочку или создайте скрипт и выполните команду:

import pandas as pd

Если ошибок не возникает, то установка прошла успешно.

5. Проблемы при установке

- Если установка через pip вызывает ошибки, убедитесь, что у вас установлены последние версии pip и setuptools:

pip install --upgrade pip setuptools. - При установке через conda могут возникнуть проблемы с версиями Python или других пакетов. В таком случае можно указать версию pandas:

conda install pandas=1.2.3.

Основы работы с объектами pandas: Series и DataFrame

Библиотека pandas предоставляет два основных объекта для работы с данными: Series и DataFrame. Эти структуры данных позволяют эффективно манипулировать и анализировать информацию в Python.

Series представляет собой одномерный массив с метками (индексами), который может содержать данные любого типа, включая числа, строки и даты. Каждый элемент в Series связан с индексом, который может быть задан вручную или автоматически сгенерирован. Создание Series происходит через передачу списка или массива в функцию pd.Series().

Пример:

import pandas as pd

data = [1, 2, 3, 4, 5]

series = pd.Series(data)По умолчанию индексы будут автоматически присвоены от 0 до 4. Индекс можно задать вручную:

series = pd.Series(data, index=['a', 'b', 'c', 'd', 'e'])DataFrame – это двумерная структура данных, которая представлена таблицей с колонками и строками. Каждая колонка в DataFrame является объектом Series, а строки представляют собой наборы данных. DataFrame является основным инструментом для работы с табличными данными в pandas. Он может быть создан из списка списков, словаря, массива NumPy или других структур данных.

Пример:

data = {'name': ['Alice', 'Bob', 'Charlie'], 'age': [25, 30, 35]}

df = pd.DataFrame(data)В этом примере создается DataFrame с двумя колонками: name и age.

Для работы с данными в DataFrame можно использовать методы, такие как df['name'] для доступа к колонке, или df.iloc[0] для доступа к первой строке. Также доступны операции фильтрации и агрегации, например:

filtered_df = df[df['age'] > 28]Методы head() и tail() позволяют быстро просматривать первые или последние строки DataFrame:

df.head()Оба объекта, Series и DataFrame, обеспечивают гибкость в обработке данных и являются основой для многих операций в pandas, таких как группировка, слияние и агрегация данных.

Как импортировать и загружать данные с помощью pandas

Для работы с данными в pandas используется функция read_csv() для загрузки данных из CSV файлов. Пример кода:

import pandas as pd

data = pd.read_csv('file.csv')По умолчанию pandas ожидает, что данные в CSV файле разделены запятой. Если используется другой разделитель (например, точка с запятой), необходимо указать параметр sep:

data = pd.read_csv('file.csv', sep=';')Для загрузки Excel файлов используется функция read_excel(). Пример загрузки первого листа Excel документа:

data = pd.read_excel('file.xlsx')Если в Excel файле несколько листов, можно выбрать нужный, передав имя листа в параметре sheet_name:

data = pd.read_excel('file.xlsx', sheet_name='Sheet2')Для работы с базами данных можно использовать read_sql(), которая позволяет извлекать данные напрямую из SQL запросов. Пример использования:

import sqlite3

conn = sqlite3.connect('database.db')

query = 'SELECT * FROM table_name'

data = pd.read_sql(query, conn)При работе с файлами JSON можно использовать функцию read_json(), которая автоматически преобразует структуру JSON в pandas DataFrame:

data = pd.read_json('file.json')Кроме того, pandas поддерживает другие форматы, такие как HDF5 (read_hdf()), Parquet (read_parquet()), и Feather (read_feather()). Каждый из этих форматов подходит для работы с большими объемами данных и имеет свои особенности.

Как манипулировать данными: фильтрация, сортировка, изменение значений

Фильтрация данных осуществляется с помощью логических выражений. Например, чтобы выбрать строки, где значение в столбце "age" больше 30, используем:

df[df['age'] > 30]

Можно комбинировать условия. Чтобы выбрать строки, где "age" больше 30 и "salary" больше 50000:

df[(df['age'] > 30) & (df['salary'] > 50000)]

Для более сложных фильтров удобно использовать методы like и str.contains, когда нужно фильтровать по подстроке:

df[df['name'].str.contains('John')]

Сортировка данных в pandas осуществляется с помощью метода sort_values(). Сортировка выполняется по одному или нескольким столбцам. Например, чтобы отсортировать DataFrame по возрасту по убыванию:

df.sort_values(by='age', ascending=False)

Если требуется сортировка по нескольким столбцам, например, по возрасту и затем по зарплате, используем:

df.sort_values(by=['age', 'salary'], ascending=[False, True])

Изменение значений данных чаще всего требует работы с методами замены и обновления. Для замены значений в определённом столбце можно использовать метод .replace(). Например, чтобы заменить все значения "male" на "M" в столбце "gender":

df['gender'] = df['gender'].replace('male', 'M')

Если нужно заменить значения в столбце в зависимости от условия, можно воспользоваться методом .apply() с лямбда-функцией. Например, для создания нового столбца, который будет содержать «young» для людей младше 30 лет и «old» для всех остальных:

df['age_group'] = df['age'].apply(lambda x: 'young' if x < 30 else 'old')

Для замены значений на основе индекса используйте метод .at[]. Он позволяет заменять значения по определенному индексу. Например, если нужно изменить значение в строке с индексом 2 и столбце "salary":

df.at[2, 'salary'] = 55000

Понимание и использование этих методов позволяет эффективно управлять данными, подготавливая их для дальнейшего анализа или визуализации.

Агрегирование данных в pandas: группировка и вычисление статистик

В pandas агрегирование данных осуществляется через метод groupby(), который позволяет группировать данные по определённым признакам, после чего можно вычислять статистические показатели для каждой группы. Это полезно при анализе данных, где важно рассматривать подмножества, а не всю выборку целиком.

Основной принцип работы с groupby() заключается в следующем: сначала данные делятся на группы по значениям одного или нескольких столбцов, затем выполняется агрегация этих групп с использованием различных функций, таких как сумма, среднее значение, максимум, минимум и другие.

Пример базовой группировки:

import pandas as pd

df = pd.DataFrame({

'Город': ['Москва', 'Москва', 'Санкт-Петербург', 'Санкт-Петербург'],

'Продажи': [100, 200, 150, 250]

})

grouped = df.groupby('Город')['Продажи'].sum()

print(grouped)

В данном примере данные о продажах группируются по городам, и для каждой группы рассчитывается сумма.

Агрегация может включать несколько операций одновременно. Для этого используется метод agg(), который позволяет применять несколько статистических функций к одной группе. Например, можно рассчитать как среднее, так и стандартное отклонение для каждого поднабора:

grouped_stats = df.groupby('Город')['Продажи'].agg(['mean', 'std'])

print(grouped_stats)

При необходимости можно агрегировать по нескольким столбцам. Для этого в groupby() передаются несколько колонок. Пример:

df = pd.DataFrame({

'Город': ['Москва', 'Москва', 'Санкт-Петербург', 'Санкт-Петербург'],

'Магазин': ['A', 'B', 'A', 'B'],

'Продажи': [100, 200, 150, 250]

})

grouped = df.groupby(['Город', 'Магазин'])['Продажи'].sum()

print(grouped)

Существует также метод pivot_table(), который позволяет создавать сводные таблицы, где группировка и агрегация выполняются одновременно, с возможностью указания разных функций для разных столбцов. Это полезно для создания отчетов, где данные группируются по нескольким признакам, а затем выполняется расчёт статистик для каждого пересечения:

pivot = df.pivot_table(values='Продажи', index='Город', columns='Магазин', aggfunc='sum')

print(pivot)

Кроме стандартных статистических функций, таких как sum(), mean(), min(), max(), pandas поддерживает более сложные операции. Например, можно вычислять медиану с помощью median(), количество элементов в группе через count(), или применить пользовательскую функцию с помощью apply().

Для более сложных случаев можно использовать transform(), который позволяет выполнять агрегацию и одновременно возвращать результат с той же размерностью, что и исходные данные. Это полезно, например, когда нужно вычислить показатели для каждой строки, но при этом учитывать информацию по всей группе.

Важно помнить, что после группировки данные могут быть как агрегированы до одного значения, так и оставаться с той же структурой, но с применением вычислений, что открывает широкие возможности для анализа и обработки больших наборов данных.

Работа с пропущенными значениями в pandas

В pandas пропущенные значения могут появляться по разным причинам: ошибки ввода данных, проблемы при извлечении информации или отсутствие значения в определённых строках. Основные подходы к обработке таких значений включают их удаление, замену или использование специальных методов для анализа.

Для начала необходимо понимать, как pandas обрабатывает пропущенные значения. В библиотеке pandas пропущенные значения представлены объектом NaN (Not a Number) из библиотеки NumPy. Проверка на наличие пропущенных значений осуществляется с помощью методов isna() и isnull().

df.isna()– возвращает DataFrame с булевыми значениями, гдеTrueозначает наличие пропуска.df.isnull()– эквивалентенisna(), используется для проверки наNaNзначения.

Часто требуется заполнить пропуски или удалить их. Для этих задач pandas предоставляет несколько методов:

Удаление пропущенных значений

Чтобы удалить строки или столбцы с пропущенными значениями, используется метод dropna().

df.dropna()– удаляет все строки с хотя бы однимNaNзначением.df.dropna(axis=1)– удаляет столбцы, содержащие хотя бы одноNaNзначение.df.dropna(how='all')– удаляет строки, в которых все значения пропущены.

Удаление пропусков эффективно, но может привести к потере значимой информации, особенно при работе с большими датасетами.

Заполнение пропущенных значений

Заполнение пропущенных значений – один из распространённых способов обработки данных. Это можно сделать с помощью метода fillna().

df.fillna(value)– заполняет все пропущенные значения заданным значением, например, 0 или средним значением столбца.df.fillna(method='ffill')– использует значение предыдущей строки для заполнения пропуска (метод вперёд).df.fillna(method='bfill')– использует значение следующей строки для заполнения пропуска (метод назад).

Выбор метода заполнения зависит от контекста данных. Например, заполнение средним значением подходит для числовых столбцов, а метод «вперёд» полезен для временных рядов.

Заполнение пропущенных значений статистикой

Вместо использования фиксированного значения для замены пропусков можно заполнить их статистическими показателями столбца:

df.fillna(df.mean())– заполняет пропуски средним значением столбца.df.fillna(df.median())– заполняет пропуски медианой столбца.df.fillna(df.mode().iloc[0])– заполняет пропуски наиболее частым значением столбца.

Прогнозирование пропущенных значений

В более сложных случаях для заполнения пропусков можно использовать алгоритмы машинного обучения, например, линейную регрессию, деревья решений или KNN. Эти методы предсказывают пропущенные значения на основе имеющихся данных, но требуют предварительной подготовки и моделирования.

Важные рекомендации

- Перед обработкой пропусков проанализируйте данные, чтобы понять, почему они отсутствуют, и выбрать подходящий способ обработки.

- Используйте заполнение пропусков в тех случаях, когда это оправдано, чтобы не исказить статистику.

- Не забывайте проверять распределение данных после замены пропусков, чтобы убедиться, что метод не повлиял на результаты.

Как визуализировать данные с помощью pandas и matplotlib

Для визуализации данных в pandas часто используется библиотека matplotlib, которая позволяет создавать графики напрямую из DataFrame или Series. Основное преимущество заключается в интеграции matplotlib с pandas, что упрощает процесс создания различных типов графиков, таких как линии, гистограммы, диаграммы рассеяния и другие.

Прежде чем начать визуализировать данные, нужно импортировать необходимые библиотеки. Обычно это делается так:

import pandas as pd

import matplotlib.pyplot as pltПосле импорта библиотек можно работать с данными. Рассмотрим несколько примеров, как можно визуализировать данные из pandas.

Линейный график

Для создания линейного графика достаточно вызвать метод plot() у DataFrame или Series. Например, если у вас есть DataFrame с временными данными, можно построить график изменения значений по времени:

df = pd.DataFrame({'Дата': pd.date_range('2025-01-01', periods=10, freq='D'),

'Значение': [1, 3, 2, 4, 5, 3, 6, 7, 6, 8]})

df.plot(x='Дата', y='Значение', kind='line')

plt.show()В данном примере на оси X будет расположена дата, а на оси Y – значения. Метод plot() автоматически создаст линейный график, который можно настроить дополнительно с помощью matplotlib.

Гистограмма

Гистограмму можно создать с помощью того же метода plot(), но указав параметр kind='hist'. Гистограмма поможет визуализировать распределение значений в данных:

df = pd.DataFrame({'Значение': [1, 3, 2, 4, 5, 3, 6, 7, 6, 8]})

df.plot(kind='hist', bins=5, alpha=0.7)

plt.show()Здесь метод plot() создаст гистограмму, где параметр bins задает количество интервалов (корзин), а alpha регулирует прозрачность.

Диаграмма рассеяния

Диаграмму рассеяния удобно строить с помощью параметра kind='scatter'. Это полезно для визуализации взаимосвязей между двумя переменными:

df = pd.DataFrame({'X': [1, 2, 3, 4, 5],

'Y': [1, 4, 9, 16, 25]})

df.plot(kind='scatter', x='X', y='Y')

plt.show()Этот график показывает квадратичную зависимость между переменными X и Y. Диаграмма рассеяния удобна для выявления закономерностей и трендов в данных.

Дополнительные настройки

Метод plot() в pandas имеет множество параметров для тонкой настройки графиков. Например, можно изменить цвета графиков, добавлять подписи, заголовки, сетку и т.д. Все эти элементы можно настроить с помощью matplotlib:

df.plot(kind='line', x='Дата', y='Значение')

plt.title('Заголовок графика')

plt.xlabel('Дата')

plt.ylabel('Значение')

plt.grid(True)

plt.show()Метод plt.title() добавляет заголовок, plt.xlabel() и plt.ylabel() – подписи осей, а plt.grid() включает сетку.

Сохранение графика

После создания графика его можно сохранить в файл с помощью метода savefig():

df.plot(kind='line', x='Дата', y='Значение')

plt.savefig('plot.png')Этот код сохраняет график в файл plot.png в текущую рабочую директорию.

Визуализация с помощью pandas и matplotlib – это мощный инструмент для анализа данных. Он позволяет быстро и эффективно выявлять закономерности и тренды, которые не всегда очевидны при простом просмотре данных в таблице.

Экспорт и сохранение данных в разные форматы с помощью pandas

Библиотека pandas предлагает множество инструментов для экспорта данных в различные форматы, что позволяет эффективно интегрировать данные с другими системами или анализировать их вне Python. Для сохранения данных в файл pandas использует методы, связанные с объектом DataFrame.

CSV – один из самых популярных форматов для хранения табличных данных. Для экспорта DataFrame в CSV достаточно использовать метод to_csv(). Вы можете указать путь к файлу, а также настройки разделителя, кодировки и другие параметры.

Пример:

df.to_csv('data.csv', index=False, encoding='utf-8')Параметр index=False позволяет избежать сохранения индексов строк в файл.

Excel – pandas поддерживает экспорт данных в файлы Excel с помощью метода to_excel(). Также возможно работать с несколькими листами в одном файле.

Пример:

df.to_excel('data.xlsx', sheet_name='Sheet1', index=False)Для работы с Excel необходимо установить дополнительную библиотеку openpyxl или xlsxwriter для записи файлов формата .xlsx.

JSON – формат, часто используемый для обмена данными между веб-приложениями. pandas предоставляет метод to_json() для экспорта данных в формат JSON. Вы можете настроить как структурировать данные, например, в виде объектов или списка записей.

Пример:

df.to_json('data.json', orient='records', lines=True)Параметр orient='records' сохраняет данные в виде списка объектов, а lines=True позволяет записывать каждый объект JSON на отдельной строке.

SQL – для работы с базами данных pandas поддерживает методы экспорта в SQL с использованием библиотеки SQLAlchemy. Метод to_sql() позволяет записывать данные в таблицу базы данных.

Пример:

from sqlalchemy import create_engine

engine = create_engine('sqlite:///database.db')

df.to_sql('table_name', engine, index=False, if_exists='replace')Параметр if_exists='replace' указывает, что если таблица существует, она будет перезаписана. Можно использовать значения 'fail', 'replace' или 'append'.

HDF5 – формат для хранения больших объемов данных, поддерживающий иерархическую структуру. Метод to_hdf() позволяет сохранять DataFrame в формате HDF5. Этот формат полезен для обработки данных, которые не помещаются в оперативной памяти.

Пример:

df.to_hdf('data.h5', key='df', mode='w')Ключ key указывает на название объекта в файле HDF5.

Parquet – эффективный формат для хранения данных, часто используемый в аналитических системах и больших данных. Он позволяет сохранять данные с минимальными размерами файлов и высокой производительностью чтения.

Пример:

df.to_parquet('data.parquet', engine='pyarrow')Формат Parquet также поддерживает сжатие данных, что позволяет уменьшить размер файла.

При экспорте данных важно учитывать требования к формату, такие как поддержка сжатия, производительность и совместимость с другими инструментами. В pandas можно гибко настраивать процесс экспорта, чтобы он соответствовал специфическим задачам.

Вопрос-ответ:

Что такое библиотека pandas в Python и зачем она нужна?

Библиотека pandas — это мощный инструмент для работы с данными в Python. Она предоставляет структуры данных, такие как DataFrame и Series, которые позволяют удобно и эффективно манипулировать, анализировать и обрабатывать данные. Это незаменимый инструмент для тех, кто работает с большими объемами информации, например, в области анализа данных, статистики или машинного обучения. pandas поддерживает разнообразные операции, включая фильтрацию данных, агрегацию, объединение таблиц и многое другое. Благодаря удобному синтаксису и большому количеству функций, pandas делает процесс работы с данными значительно проще.

Какие основные структуры данных предоставляет pandas?

В pandas две основные структуры данных: Series и DataFrame. Series представляет собой одномерный массив, аналогичный списку или массиву в Python. Это упорядоченная коллекция элементов с индексами. DataFrame — это двухмерная таблица, похожая на таблицу в базе данных или Excel, состоящая из строк и столбцов. DataFrame позволяет хранить данные разных типов в разных столбцах, что делает его удобным для работы с различными источниками данных и их анализом.

Что такое библиотека pandas в Python и для чего она нужна?

Pandas — это библиотека для языка программирования Python, предназначенная для удобной работы с данными, в частности с табличными данными, такими как таблицы Excel или базы данных. Она предоставляет мощные структуры данных, такие как DataFrame и Series, которые позволяют легко манипулировать данными: фильтровать, сортировать, агрегистрировать, а также выполнять различные математические операции. Это один из самых популярных инструментов для анализа данных и подготовки данных для машинного обучения.